Algoritmes … zij leven onder ons! Een supermarkt voorspelt welke klanten zwanger zijn. De politie identificeert straten waar die avond misdaden zullen plaatsvinden. Een rechter bepaalt enkel op basis van persoonsgegevens welke personen in hechtenis een vluchtrisico vormen. Allemaal uitkomsten van een algoritme, op dit moment al in gebruik.

Kunstmatige intelligentie maakt grote stappen en evolueert met de dag. De snelheid hiervan is zo veel groter dan mensen kunnen bijhouden dat velen vrezen dat we in twee à drie decennia afstevenen op de zogeheten singulariteit . Publieke figuren als Stephen Hawking Elon Musk hebben de afgelopen jaren hun zorgen hierover geuit.

Er is echter ook een ander risico van AI, één waar we nu al middenin zitten.

AI vs NS

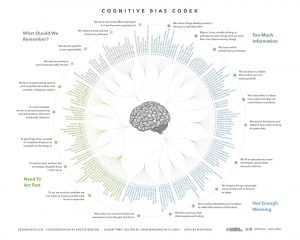

Wat is dit gevaar dat kunstmatige intelligentie op dit moment in de hand werkt? Dat heet Natuurlijke Stomheid (NS). Als mensen zitten we nu eenmaal zo in elkaar dat ons denken vol met valkuilen zit. Valkuilen die we verzameld cognitive biases noemen; of, ietwat botter uitgedrukt, natuurlijke stomheid.

De huidige stand van kunstmatige intelligentie is dat alle AI-systemen in het dagelijks gebruik onder de noemer zwakke AI vallen. Dit betekent dat de algoritmes zich focussen op het oplossen van een bepaald type probleem, vaak heel specifiek. Veel mensen behandelen de systemen echter alsof ze de intelligentie van mensen hebben, maar zonder menselijke subjectiviteit. Maar is het vertrouwen in de onfeilbaarheid van machines wel terecht? Zijn algoritmes wel zo objectief als door velen wordt gedacht?

Het gevaar op korte termijn is niet dat AI de wereld gaat overnemen, maar dat wij de wereld uit ons handen laten vallen in de verwachting dat AI het wel zal opvangen. Het is dus niet alleen kunstmatige intelligentie, maar ook natuurlijke stomheid waarvoor wij moeten waken.

In dit artikel ga ik in op enkele valkuilen en waartoe die kunnen leiden. Daarna bespreek ik hoe we hier bewuster en verstandiger mee om kunnen gaan.

“Er stond dat ik het moest doen…”

Gelukkig kon hij op tijd uit de auto klimmen, zijn koffer eruit halen en de alarmlijn bellen. Maar de Ford Focus die deze 32-jarige man had gehuurd, zat met zijn onderkant vastgeklemd tussen de rails. De aankomende trein kon niet op tijd remmen en sleurde de auto tientallen meters mee tot het veranderde in een vuurzee. De vijfhonderd passagiers in de New Yorkse trein stonden vervolgens twee uur stil, tien andere treinen waren vertraagd en zo’n honderd meter aan spoor was beschadigd.

reden dat deze bezoeker uit Silicon Valley zijn auto klem reed tussen de rails? Zijn GPS instrueerde hem naar rechts te gaan, dus had hij dat gedaan. Het vertrouwen in de autonavigatie was zo groot dat dit het won van wat zijn ogen recht voor hem zagen.

Of neem de reis die Sabine Moreau ondernam. Zij vertrok op een zaterdagochtend uit haar dorp ten zuidwesten van Charleroi richting Zaventem, Brussel; een ritje dat normaal een uur duurt. Haar navigatie stuurde haar wat anders dan normaal, maar geen reden om te twijfelen, toch? Ook niet toen de borden voor Aken, Keulen en Frankfurt voorbij kwamen, ze twee keer moest voltanken, door de Alpen moest rijden en ze besloot dat ze vanwege vermoeidheid even moest stoppen om te slapen. Pas toen ze in Zagreb, Kroatië aankwam, realiseerde ze zich dat het niet goed was gegaan en nam ze dezelfde weg terug.

Extreme gevallen waarin het gezonde verstand volledig uitgeschakeld lijkt te zijn. Meer en meer vertrouwen we erop dat wat een algoritme voor ons vaststelt, wel zal kloppen. Daar willen we op vertrouwen, want hé, daar hebben we toch juist computers voor! Toegegeven, als mijn rekenmachine me verteld dat de wortel van 1999 afgerond op drie decimalen 44,710 is, dan zijn er maar weinig momenten dat ik dat met de hand ga narekenen.

Het voortdurend gebruik van machinerekenkracht en -geheugen in plaats van die van jezelf heeft ook andere consequenties: je vaardigheden nemen af. Vind nog maar eens iemand die de nummers uit zijn telefoon ook uit zijn hoofd kent. Wat je niet meer oefent, beheers je ook niet meer. Grappig, onbelangrijk of misschien een beetje lastig in sommige gevallen, maar fataal in andere gevallen, zoals alle inzittenden van vlucht 3407 ondervonden toen de piloot de besturing moest overnemen van de autopilot …

“Regels zijn regels”

De 41-jarige John Gass ontving een brief dat zijn rijbewijs per direct was ingetrokken. De paniek sloeg toe. Een chauffeur zonder problemen in het verkeer, al jaren niet eens een boete. Waarom was dit gebeurd? Na herhaaldelijk bellen ontving hij het antwoord: een gezichtsherkenningsalgoritme gebruikt voor antiterrorisme had zijn foto geflagd. Het had bepaald dat zijn foto zo veel op die van een andere chauffeur leek dat identiteitsfraude waarschijnlijk werd geacht. Automatisch was zijn rijbewijs ingetrokken. Pas na tien dagen kreeg hij hem terug, nadat hij had aangetoond dat hij echt was wie hij was.

De huidige wereld is er één waarin algoritmes tot steeds meer in staat zijn en steeds meer worden ingezet om te doen wat wij mensen lastig vinden of misschien niet eens kunnen. Daarmee creëren we een nieuwe autoriteit waaraan het makkelijk is verantwoordelijkheid te delegeren.

Het probleem is niet zo zeer dat algoritmes fouten kunnen maken. Mensen maken ook fouten. Meer zelfs wellicht. Nee, het probleem is dat met de inzet van algoritmes het beeld leeft dat het ‘foutgevoelige’, ‘menselijke’ element eruit is gehaald en dat analyses nu ‘objectief’ zijn.

Maar hoe komen algoritmes tot stand? De bron is uiteindelijk een set van regels bedacht door mensen. En bewust of onbewust, onze aannames en vooronderstellingen sluipen hierin. Maar zelflerende algoritmes dan, hoor ik je denken. Uiteindelijk worden die getraind met datasets en bij de selectie van zo’n dataset, inderdaad, spelen eveneens die aannames en vooronderstellingen.

Algoritmes zijn in die zin verlengstukken van mensen. De oneffenheden van het menselijk denken worden niet weggepoetst, alleen omdat de stappen nu door machines worden uitgevoerd. Sterker nog, ze kunnen zelfs uitvergroot worden.

“Creëer je eigen waarheid”

Wat hebben Ronaldo, Griezmann, Neymar, Suárez en Depay met elkaar gemeen, behalve dat ze tot de top van het internationale voetbal behoren?

Allen zijn ze geboren in de eerste drie maanden van het jaar. Laten we de internationale top 100 eens bestuderen en goed kijken naar de geboortemaand. Wat valt op? Als we de verjaardagen groeperen per kwartaal krijgen we de onderstaande grafiek.

We zien hier een relatie tussen sportieve prestatie en verjaardag. Een buitenproportioneel groot deel van de topspelers is

geboren in de eerste maanden van het jaar en een buitenproportioneel klein deel in de laatste maanden. Deze relatie is niet alleen te vinden in deze top 100, maar in alle topdivisies. En niet alleen in voetbal, maar in heel veel sporten. Dit heeft zelfs een naam: Relative age effect .

Dus hebben we hier het begin van een voorspellend algoritme te pakken? Kunnen we nu bij geboorte al bepalen welke kinderen het best in sport zullen zijn? Dat spaart weer werk.

Even pas op de plaats! Want hier wordt het makkelijk oorzaak en gevolg door elkaar te halen. De reden is niet de maand op zich, maar de groepering en selectie die op basis hiervan wordt gedaan. Bij hun eerste training worden jonge spelers namelijk ingedeeld op kalenderjaar. Maar tussen een kind geboren in januari 2013 en een kind geboren in december 2013 zit een verschil van zowat een jaar. Een groot verschil op die leeftijd, dat zich uit in zowel kracht als mentale vaardigheden. Als na het eerste jaar de beste spelertjes worden geselecteerd voor het sterelftal, waarin ze meer bevestiging en meer mogelijkheden krijgen, wie komen er dan het meest in voor? En dit jaar op jaar, tot de effecten waar zijn geworden en deze spelers echt de betere spelers zijn.

Dit is een self-fulfilling prophecy . Een proces dat vanwege een positieve feedback-loop zijn eigen waarheid weet te creëren. Dit is wat ook zo kan gebeuren met algoritmes. Als output van een algoritme weer als input wordt teruggekoppeld om een voorspelling te verfijnen, wordt een klein verschil, bewust of onbewust, zodanig versterkt dat het een groot verschil gaat worden.

Willen we dat algoritmes het verleden herhalen, met al zijn fouten, of willen we wat anders? Want scheve datasets, vooroordelen van de ontwikkelaars en fouten in logica leiden tot algoritmes die seksistische en racistische voordelen versterken.

Mens vs Machine

Als je de voorgaande paragrafen leest, zou je kunnen denken dat ik geen voorstander ben van algoritmes, maar dan heb je het mis. Om een probleem stapsgewijs op te lossen en dit te automatiseren is iets dat ons helpt en dat ons leven makkelijker maakt. Het is fascinerend om te zien hoe verbanden naar boven komen die eerst onzichtbaar leken. Het is intrigerend om mee te maken als een AI ‘dit uit zichzelf doet’, ofwel als wij de stappen niet meer overzien waarmee een proces wordt uitgevoerd. Maar ik ben zeker kritisch over onnadenkend gebruik en blind vertrouwen in algoritmes.

Hoe kunnen we de voordelen van kunstmatige intelligentie benutten zonder in al te veel van de valkuilen te stappen? Het begint met begrijpen. Begrijpen waar algoritmes goed in zijn en waarin niet. Begrijpen waar mensen goed in zijn en waarin niet.

Algoritmes blinken uit in het consequent doorwerken van grote hoeveelheden data en deze te sorteren, prioriteren en classificeren. Deze kunnen zij, of andere algoritmes, vervolgens filteren of associëren. Oftewel, het vinden van een naald in een hooiberg. Zoals in het plaatje hieronder.

Waar de meesten van ons een paar keer goed moeten kijken wat hier afwijkend aan is (en sommigen het nog steeds niet zien), hoeft een algoritme niet eens met zijn spreekwoordelijke ogen te knipperen.

Waar zijn mensen sterker in? Bekijk het onderstaande plaatje eens.

In deze bekende optische illusie zien mensen een eend … of een konijn … of allebei. Zodra je het doorhebt, kan je beide zien en accepteren dat het beide is. Mensen zijn goed in context snappen en omgaan met verandering binnen een context. Oftewel, snel betekenis geven aan een patroon. Dit is dan weer iets waar AI’s mee worstelen.

Het beste van beide

Hoe nu verder? Algoritmes afzweren en terugkeren naar vroeger tijden is geen realistische optie. Zonder algoritmes geen zoekmachines—dus zelf de juiste webpagina maar vinden. Wat zeg ik? Zonder algoritmes überhaupt geen web en geen computers. Daar gaat je avondje Netflix.

Maar achterover hangen en er vanuit gaan dat de AI het wel oplost, is ook een roekeloze optie, zoals we in de voorgaande voorbeelden hebben gezien. De enige weg voorwaarts is dus een juiste balans vinden tussen kunstmatige en natuurlijke intelligentie.

Hoe kan zo’n samenwerking eruit zien? Door de kracht van AI te gebruiken waar je zelf te kort schiet en door te accepteren wat de beperkingen van AI zijn. Door dan je verantwoordelijkheid te nemen en dit aan te vullen met je menselijke intelligentie.

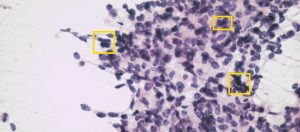

Een mooi voorbeeld is medische diagnostiek. Algoritmes zijn sterk in het vinden van patronen. In het doorlopen van duizenden

foto’s en eruit te pikken wat afwijkt van de norm. Als mens zal je eerder tussen duizenden puntjes die ene net over het hoofd zien en dat kan fataal zijn. Maar waar is de arts goed in? Het geven van betekenis aan datgene wat afwijkt. Als zij geattendeerd wordt op een detail van een foto kan zij snel inschatten of dit iets is waar actie op moet worden ondernomen of niet.

Transparantie voor succesvolle samenwerking

Voor een succesvolle samenwerking tussen natuurlijke en kunstmatige intelligentie is het belangrijk dat algoritmes worden ontwikkeld en aangeboden op een bepaalde manier. Een manier die het beste aansluit bij het verenigen van de krachten en het uitsluiten van misverstanden.

In één woord heet dat transparantie. Transparantie over wat erin gaat en transparantie over wat eruit komt.

Transparantie over de input is belangrijk om de gebruiker de waarde van een algoritme in te laten schatten. Stel, ik gebruik een algoritme om mijn kans op een succesvolle operatie te laten berekenen. Als ik weet dat de relevante input voor dit algoritme de letters van mijn naam en mijn sterrenbeeld zijn, dan hecht ik hier een andere waarde aan dan ik anders had gedaan. Vaagheid over de werking van een algoritme, en dan vooral van een slecht algoritme, kan tot veel problemen leiden, zoals een notoire zaak over zorgvergoeding in Idaho liet zien.

Transparantie over de output is belangrijk om een gebruiker niet blind te laten staren op één uitkomst. Zonder toelichting kan een uitkomst een air van zekerheid hebben die onverdiend is. Als een algoritme van een cluster cellen met een zekerheid van 50,1% vaststelt dat dit kwaadaardig is, zou je dan willen dat de arts dit percentage weet voor zij tot opereren overgaat?

Het blijft mensenwerk

Wellicht is het kantelpunt al geweest en leidt de ontkoppeling van intelligentie van bewustzijn tot een dramatische transformatie van de mensheid, zoals Yuval Noah Harari betoogt in zijn boek Homo Deus. Maar laten we hier met ons verstand erbij mee omgaan en sturing geven waar we kunnen.

Dat begint bij onszelf, nu, op dit moment. Voor ons als professionals in de digitale wereld die algoritmes ontwikkelen en in technische oplossingen toepassen. Voor ons allen als deelnemers van een maatschappij waarin algoritmes een steeds belangrijkere rol spelen en bepalen hoe onze levens eruit zien. Onze levens, want het blijft mensenwerk.

Leon Wolters,

Consultant Digitale Enterprise

Inspiratie en verder lezen:

– Brian Christian & Tom Griffiths, Algorithms to Live By: The Computer Science of Human Decisions

– Hannah Fry, Hello World. How to Be Human in the Age of the Machine

– Yaval Noah Harari, Homo Deus: A Brief History of Tomorrow

– Marcus du Sautoy, The Creativity Code: How AI Is Learning to Write, Paint, and Think

– Gary Smith, The AI Delusion

Meer ALTEN nieuws lezen? Ga dan naar deze pagina